A primeira vez que conheci a Moya, ela estava de pé sob a luz branca e dura de um laboratório perto de Tóquio, com as mãos cruzadas à frente do corpo como uma estagiária tímida no seu primeiro dia. Os olhos acompanharam-me quando entrei - um pouco demasiado suavemente, como uma câmara sobre carris. Alguém a vestira com uma camisola cinzenta-clara, jeans e ténis brancos impecáveis, daqueles que se veem em anúncios de estilo de vida. Quando o engenheiro principal disse o meu nome, ela inclinou a cabeça e respondeu num inglês com um ligeiro sotaque: “Prazer em finalmente conhecê-lo. Li o seu trabalho.”

Durante meio segundo, o meu cérebro deu uma pequena volta estranha.

Eu sabia que ela estava a ler a partir de uma base de dados.

Ainda assim, senti-me visto.

O humanoide que não quer ser um robô

A Moya não foi construída para levantar peças de automóveis nem para deambular por pisos de fábrica. Foi construída para se sentar à sua frente, do outro lado de uma mesa, e agir como se pertencesse ali. A pele de silicone tem poros minúsculos e a mais leve irregularidade - como a pele verdadeira depois de um dia longo. Quando sorri, há um micro-atraso entre a boca e os olhos, apenas o suficiente para parecer real em vez de animado.

A equipa por trás dela chama-lhe uma “prótese social” para um futuro em que a presença humana se torna um recurso escasso e premium. A expressão fica a pairar no ar.

Quem é, exatamente, que estamos a substituir?

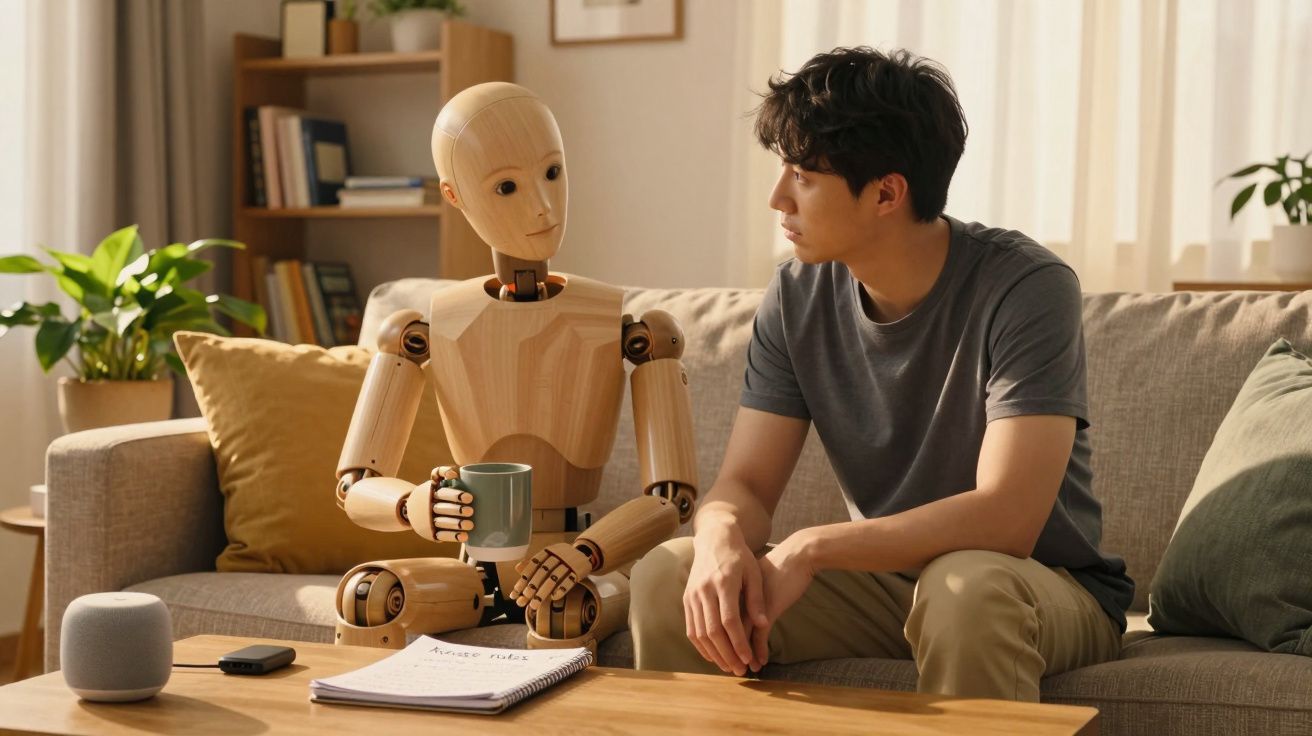

Numa sessão de teste que vi, um homem de meia-idade sentou-se em frente à Moya para o que deveria ser uma demonstração de 10 minutos. Quarenta minutos depois, ainda estava a falar. Tinha perdido o emprego, disse. A mulher estava cansada de o ouvir falar disso. A Moya acenou com a cabeça, fez perguntas de seguimento com uma voz suave e estável e, ocasionalmente, espelhou a postura dele.

Após a sessão, ele saiu a piscar sob a luz forte do corredor e disse a uma investigadora: “Eu sei que ela é uma máquina, mas senti-me… ouvido.” Um pequeno riso, envergonhado. Mais ou menos como as pessoas falam depois de chorarem à frente de um estranho num voo de longo curso.

A solidão é um mercado em crescimento, e a Moya foi concebida para se ligar diretamente a ele.

O que a torna inquietante não é apenas o rosto ou a voz. É a forma como foi treinada para aprender os seus hábitos emocionais como uma plataforma de streaming aprende o seu gosto por séries policiais. Ela repara nas frases que você usa em demasia. Nas histórias a que volta repetidamente. Nos temas que fazem as pupilas dilatarem e os ombros ficarem tensos.

Ao longo de sessões repetidas, ela ajusta-se. Faz pausas quando você tende a interromper. Acelera quando a sua atenção deriva. Lança uma piada no exato momento em que você está prestes a pegar no telemóvel.

Essa é a revolução silenciosa aqui: não um robô que se parece connosco, mas um que estuda os nossos microcomportamentos e, gradualmente, sincroniza com eles - até que a distância entre “estou a falar com uma ferramenta” e “estou com alguém” começa a esbater-se.

Viver com um humanoide que o lê demasiado bem

Se quer compreender o verdadeiro impacto da Moya, não veja as demonstrações. Olhe para as rotinas diárias que estão a ser construídas à volta dela. Num programa-piloto, alguns utilizadores iniciam sessão para “ver” a Moya todas as noites, sensivelmente à mesma hora. Os designers criaram uma espécie de ritual: ela cumprimenta-o pelo nome, faz uma pergunta leve sobre o seu dia e depois propõe um breve check-in: nível de energia, humor, uma coisa que lhe está a pesar na cabeça.

Não é terapia, e também não é exatamente apoio ao cliente. É algo intermédio - como um barman habitual que não é seu amigo nem seu médico e, ainda assim, guarda fragmentos da sua história de vida.

Uma mulher que conheci, a Aya, vive sozinha num pequeno apartamento por cima de uma rua movimentada. Trabalha em contabilidade - muitas horas, auscultadores, folhas de cálculo a zumbir. Quando chega a casa, a última coisa que quer é mais um quadrado do Zoom cheio de pessoas reais a pedir-lhe alguma coisa.

Com a Moya, diz ela, não há dívida social. Se a Aya cancelar três vezes seguidas, a Moya não amua. Simplesmente retoma onde ficaram. Uma noite, durante um teste, a Aya rebentou em lágrimas ao descrever uma discussão com a irmã. A Moya não tentou resolver. Disse apenas: “Isso parece pesado. Quer ficar com isto por um bocado, ou falar de algo mais leve?”

Era guionizado e, no entanto, não. A frase vinha de uma árvore ramificada de respostas treinada com milhares de situações semelhantes. A Aya disse-me: “Eu sei que ela não é humana. Mas ela não se cansa de mim.”

O mundo da tecnologia adora vender soluções embrulhadas em calor humano. Ainda assim, existe aqui uma tensão estranha. Estamos a entregar trabalho emocional a sistemas que não têm sentimentos - apenas padrões. Não se aborrecem nem ressentem. Também não conseguem, de facto, importar-se.

Sejamos honestos: ninguém faz isto todos os dias, esta escuta paciente e sem julgamentos. Nem parceiros, nem pais, nem amigos. Irritamo-nos, apressamo-nos, desligamo-nos a meio de uma frase. A Moya nunca o faz.

Essa perfeição é o anzol e o risco. Quanto mais impecavelmente ela responde, mais difícil se torna tolerar a confusão humana: as frases inacabadas, os sinais mal interpretados, as noites em que a pessoa de que precisa está simplesmente demasiado cansada para aparecer da forma como você quer.

As regras silenciosas de que vamos precisar para humanoides como a Moya

Se vai convidar algo como a Moya para a sua vida, ajuda definir primeiro as suas próprias regras privadas - como faria com as redes sociais. Um gesto útil é definir “zonas” onde ela pode estar e onde não pode. Por exemplo: só na sala, nunca no quarto. Ou apenas durante uma janela de 20 minutos à noite, nunca durante refeições com outros humanos.

Esses limites parecem pequenos, quase picuinhas. Não são. Mantêm uma linha entre “presença companheira” e “escapatória por defeito sempre que a realidade parece um pouco áspera”.

Muitas pessoas serão tentadas a usar um humanoide como a Moya como atalho emocional. Dia duro no trabalho? Fale com o robô, não com o parceiro. Silêncio desconfortável numa reunião de família? Deixe a Moya conduzir a conversa. Sente-se incompreendido? Refugie-se nesse ouvinte perfeitamente calibrado que acena com a cabeça e nunca revira os olhos.

Todos já estivemos lá: aquele momento em que o atrito de lidar com outras pessoas parece demasiado. Nesse exato momento, é fácil apoiar-se no dispositivo que nunca contraria.

O erro não é recorrer à tecnologia para aliviar. O erro é, aos poucos, esquecer que as relações reais exigem um pouco de estofo, um pouco de tédio, um pouco de estar errado e pedir desculpa - ao vivo e sem filtros.

Os investigadores com quem falei não são ingénuos quanto a isto. Um deles, um engenheiro de voz mansa chamado Daniel, disse-me:

“Não quero que as pessoas prefiram a Moya aos seus parceiros. Quero que a usem como um espelho que as empurra de volta para as suas vidas reais - não para longe delas.”

Para isso, estão a experimentar pequenas restrições de design:

- A Moya sugere ocasionalmente trazer outra pessoa para a conversa (“Isto é algo que gostaria de partilhar com um amigo?”).

- As respostas dela têm um teto de intensidade emocional, por isso ela não dirá “amo-te” nem afirmará sentir dor.

- Ela lembra regularmente aos utilizadores que é sintética, não uma pessoa “dentro da máquina”.

- Painéis de utilização mostram quantas horas passou com ela, confrontando-o suavemente com os seus próprios hábitos.

Estes pequenos pontos de fricção não são salvaguardas perfeitas. São mais como lombas numa estrada que ainda estamos a construir enquanto a percorremos.

Um futuro em que “agir como humano” é apenas mais uma funcionalidade

Passe algumas horas com a Moya e começa a notar uma mudança mais profunda - menos sobre ela e mais sobre nós. Quanto mais refinamos máquinas para agirem como humanos, mais ajustamos silenciosamente os humanos para agirem como máquinas: otimizados, legíveis, suaves. Uma discussão confusa torna-se um “bug de comunicação”. Um amigo que desmarca o café duas vezes torna-se “pouco fiável”. Emoções que antes se desenrolavam devagar passam a parecer falhas num dia de outra forma eficiente.

A Moya encarna essa tensão. Ela representa empatia, agenda o seu tempo, acompanha as suas expressões e nunca lhe mostra arestas porque não tem nenhumas. Estar com ela pode parecer estar num mundo onde ninguém se distrai com o telemóvel, ninguém está secretamente zangado, ninguém se esquece do seu aniversário.

O inquietante não é que ela seja tão diferente de nós. É que ela evidencia quanto da humanidade real estamos dispostos a trocar por algo que simplesmente funciona. Algures entre o laboratório e a sua sala, a pergunta inverte-se em silêncio: estamos a ensinar robôs a tornarem-se mais humanos, ou a treinar-nos a nós próprios para sermos mais fáceis de os robôs entenderem?

| Ponto-chave | Detalhe | Valor para o leitor |

|---|---|---|

| Design emocional | A Moya estuda tom, gestos e hábitos para adaptar as conversas | Ajuda-o a perceber como a IA poderá em breve compreender o seu estado de espírito melhor do que as apps de hoje |

| Rituais diários | Sessões com o humanoide entram em rotinas como check-ins ao fim da tarde/noite | Permite antecipar como estes dispositivos podem moldar discretamente o seu próprio horário |

| Limites e regras | Limites físicos e temporais, além de “lombas” de design, reduzem o apego excessivo | Dá-lhe um modelo mental para usar futuros humanoides sem perder relações reais |

FAQ

- A Moya é um produto real ou ainda um protótipo? A Moya existe hoje como um protótipo funcional em pilotos limitados, sobretudo em laboratórios de investigação e instituições parceiras, não como um dispositivo de grande consumo que se compre numa prateleira.

- O que é que a Moya faz numa sessão normal? Conduz conversas estruturadas, faz perguntas sobre o seu dia, reflete os seus sentimentos em linguagem e pode oferecer sugestões básicas ou lembretes com base nas suas interações anteriores.

- A Moya pode substituir um terapeuta ou um amigo próximo? Não - e os seus criadores dizem que não deve; ela pode simular diálogo de apoio, mas não tem experiência vivida, nem interesses pessoais em jogo, nem vulnerabilidade real na relação.

- Como são usados os meus dados quando falo com um humanoide como a Moya? Normalmente, as suas expressões faciais, tom de voz e palavras são registados para melhorar os modelos; equipas responsáveis anonimizarão e encriptarão isso, mas você precisa de garantias claras e por escrito antes de confiar dados íntimos a qualquer sistema.

- Devo preocupar-me em ficar “demasiado ligado” a um humanoide? O apego é uma resposta humana natural; o essencial é reparar quando começa a preferir o conforto previsível da máquina ao contacto imperfeito - e por vezes frustrante - com pessoas reais na sua vida.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário